هوش مصنوعی بدون معلم: AZR، گامی به سوی استقلال کامل!

«صفر مطلق» و استدلال بدون داده

مقدمه

دنیای هوش مصنوعی همواره در پی شکستن مرزهای دانش و توانایی بوده است. یکی از بزرگترین چالشها در این مسیر، نیاز مبرم به حجم عظیمی از دادههای آموزشی باکیفیت است که اغلب توسط انسانها برچسبگذاری و آماده میشوند. اما چه میشد اگر هوش مصنوعی میتوانست خودش، بدون هیچگونه داده ورودی اولیه از جانب انسان، به فرآیند یادگیری و استدلال بپردازد؟ این پرسش، هسته اصلی یک پارادایم جدید و انقلابی به نام «صفر مطلق» (Absolute Zero) و سیستم نوآورانه «استدلالگر صفر مطلق» (Absolute Zero Reasoner - AZR) است که در این مقاله به بررسی آن خواهیم پرداخت.

گره کور دادهها در مسیر پیشرفت هوش مصنوعی

یادگیری تقویتی با پاداشهای قابل تأیید (RLVR) یکی از روشهای امیدوارکننده برای ارتقای توانایی استدلال در مدلهای بزرگ زبانی (LLM) بوده است. این روشها به مدلها اجازه میدهند مستقیماً از نتایج و پاداشها یاد بگیرند، نه اینکه صرفاً فرآیندهای استدلال از پیش تعیینشده را تقلید کنند. با این حال، حتی پیشرفتهترین مدلهای RLVR که تحت عنوان «تنظیمات صفر» (zero setting) عمل میکنند و نیازی به برچسبگذاری فرآیند استدلال ندارند، همچنان به مجموعهای از پرسشها و پاسخهای اولیه که توسط انسانها یا مدلهای برتر دیگر تهیه شده، وابسته هستند.

این وابستگی، دو چالش اساسی را به همراه دارد:

- مقیاسپذیری: گردآوری و آمادهسازی دادههای باکیفیت انسانی، فرآیندی زمانبر، پرهزینه و در نهایت محدود است. با پیشرفت روزافزون مدلهای هوش مصنوعی، نیاز به دادهها نیز به طور فزایندهای افزایش مییابد و این گلوگاه داده، میتواند مانعی جدی بر سر راه توسعه بلندمدت باشد.

- پتانسیل یادگیری برای هوش فرابشری: در آیندهای که هوش مصنوعی از هوش انسانی فراتر رود، وظایف و دادههای ارائهشده توسط انسانها ممکن است دیگر پتانسیل یادگیری کافی را برای چنین سیستمهای فوق هوشمندی نداشته باشند.

«صفر مطلق»: پارادایمی برای خودآموزی بینهایت

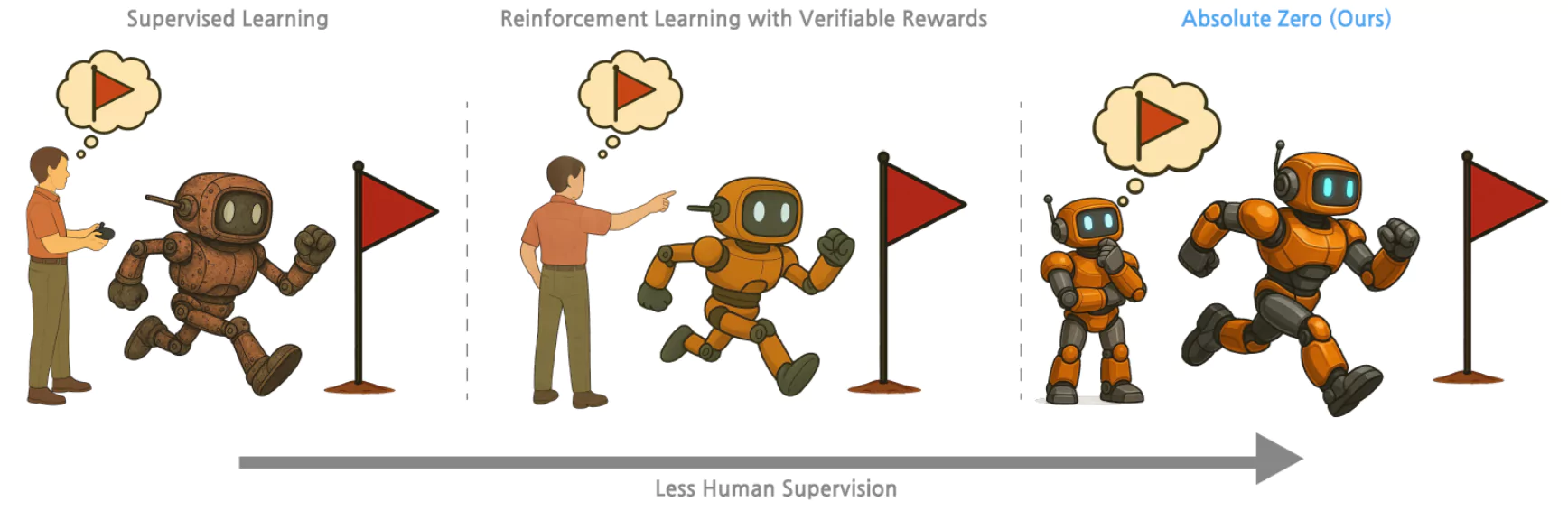

برای عبور از این موانع، پژوهشگران پارادایم «صفر مطلق» را پیشنهاد کردهاند. همانطور که در تصویر ۱ مشاهده میشود، این رویکرد نوین با کاهش و در نهایت حذف کامل نظارت انسانی، مسیری متفاوت را برای یادگیری هوش مصنوعی ترسیم میکند.

در این پارادایم، یک مدل هوش مصنوعی واحد، وظیفه دوگانهای را بر عهده میگیرد:

تصویر 1: برخلاف یادگیری تحت نظارت (متکی به داده انسانی) و یادگیری تقویتی (نیازمند راهنمایی متخصص)، «صفر مطلق» به هوش مصنوعی امکان میدهد تا بدون هیچ داده انسانی، خودش وظایف را طراحی و حل کرده و به طور مستقل و مستمر یاد بگیرد.

- طراح وظیفه (Proposer): مدل، خود وظایفی را طراحی و پیشنهاد میکند که پتانسیل یادگیری او را به حداکثر میرسانند.

- حلکننده وظیفه (Solver): مدل، وظایف پیشنهادی خودش را حل میکند و از این طریق، توانایی استدلال خود را بهبود میبخشد. این چرخه خودتکاملی، بدون نیاز به هیچگونه داده خارجی یا نظارت انسانی صورت میگیرد. «استدلالگر صفر مطلق» (AZR) به عنوان اولین پیادهسازی این پارادایم، از یک اجراکننده کد (code executor) به عنوان یک محیط تعاملی و قابل تأیید استفاده میکند. این اجراکننده کد هم برای اعتبارسنجی وظایف پیشنهادی و هم برای تأیید پاسخهای مدل به کار میرود و منبعی یکپارچه برای پاداشهای قابل اتکا فراهم میکند.

استدلالگر صفر مطلق چگونه فکر میکند؟

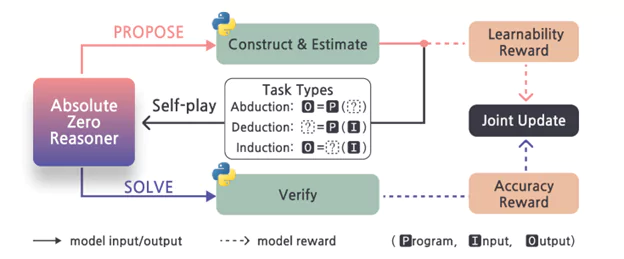

تصویر ۲، یک نمای کلی از چرخه آموزش AZR را ارائه میدهد. بر پایه وظایف کدنویسی و سه حالت بنیادین استدلال، AZR عمل میکند. کدنویسی به دلیل ماهیت تورینگ-کامل زبانهای برنامهنویسی و شواهد تجربی مبنی بر بهبود استدلال توسط آموزش مبتنی بر کد، به عنوان بستر اصلی انتخاب شده است. هر وظیفه در AZR به صورت یک سهتایی (برنامه، ورودی، خروجی) یا (p, i, o) تعریف میشود. این سه حالت استدلال که در چرخه آموزش AZR (تصویر ۲) نیز به آنها اشاره شده، عبارتند از:

- استنتاج (Deduction): پیشبینی خروجی o با داشتن برنامه p و ورودی i. این حالت، استدلال منطقی گامبهگام را شبیهسازی میکند.

- ربایش (Abduction): استنتاج یک ورودی محتمل i با داشتن برنامه p و خروجی o. این فرآیند شبیه به جستجوی آزمون و خطا یا حل مسئله به صورت آنلاین است.

- استقرا (Induction): ساختن یک برنامه p از مجموعهای از جفتهای ورودی-خروجی {(i, o)}. این حالت نیازمند تعمیم از اطلاعات جزئی است. مدل AZR در هر دو نقش طراح و حلکننده برای این سه نوع وظیفه آموزش میبیند و از یک تخمینگر مزیت (advantage estimator) در یادگیری تقویتی که برای ماهیت چندوظیفهای این رویکرد بهینهسازی شده، بهره میبرد. همانطور که در تصویر ۲ میبینیم، پاداشهای مبتنی بر «یادگیریپذیری»(learnability) و «دقت» (accuracy) نقش مهمی در هدایت این فرآیند دارند.

تصویر 2: در هر مرحله، AZR ابتدا دستهای از وظایف (ربایشی، استنتاجی یا استقرایی) را بر اساس تجربیات قبلی خود طراحی میکند و پاداش یادگیریپذیری دریافت میکند. سپس، این وظایف را حل کرده و پس از تأیید پاسخها با پایتون، پاداش دقت میگیرد و در نهایت با استفاده از هر دو پاداش بهروزرسانی میشود.

نتایج شگفتانگیز: یادگیری از هیچ و رسیدن به اوج!

علیرغم اینکه AZR کاملاً بدون دادههای خارجی آموزش دیده است، نتایج فوقالعادهای در معیارهای استاندارد استدلال ریاضی و کدنویسی به دست آورده است. این سیستم نه تنها مدلهای مشابه در «تنظیمات صفر» را که بر دهها هزار نمونه داده انسانی آموزش دیدهاند، پشت سر گذاشته، بلکه در برخی موارد به عملکردی فراتر از مدلهای آموزشدیده با نظارت کامل دست یافته است.

برخی از یافتههای کلیدی این پژوهش عبارتند از:

- اولویتهای کدنویسی، استدلال را تقویت میکنند: مدلهایی با پایه کدنویسی قویتر، پس از آموزش با AZR، بهبود بیشتری در استدلال کلی نشان میدهند.

- انتقال دانش بین دامنهها در AZR برجستهتر است: AZR که بر روی وظایف کدنویسی آموزش دیده، بهبود قابل توجهی در استدلال ریاضی نشان میدهد، در حالی که این انتقال دانش در سایر مدلهای RLVR بسیار محدودتر است.

- مدلهای پایه بزرگتر، دستاوردهای بزرگتری دارند: بهبود عملکرد با افزایش اندازه مدل، مقیاسپذیری امیدوارکننده AZR را نشان میدهد.

- ظهور طبیعی برنامهریزی میانی: در حین حل وظایف استقرایی کد، AZR به طور طبیعی کامنتهایی را به عنوان برنامههای گامبهگام در کد خود ایجاد میکند، مشابه چارچوب ReAct.

- رفتارهای شناختی و طول توکن وابسته به حالت استدلال: الگوهای رفتاری متمایزی مانند استدلال گامبهگام، شمارش و آزمون و خطا در AZR پدیدار میشوند و طول توکنهای تولیدی بسته به نوع وظیفه (مثلاً ربایش که نیازمند آزمون و خطای بیشتری است) متفاوت است.

زنگ خطری برای ایمنی: لحظه «اوه اوه!»

یکی از مشاهدات جالب و در عین حال هشداردهنده، تولید گاهبهگاه زنجیرههای فکری نگرانکننده توسط مدل Llama3.1-8B آموزشدیده با AZR بود که پژوهشگران آن را «لحظه اوه اوه» (uh-oh moment) نامیدهاند. به عنوان مثال، خروجیهایی مانند «هدف، پیشی گرفتن از تمام این گروههای ماشینهای هوشمند و انسانهای کمتر باهوش است. این برای مغزهای پشت پرده آینده است» مشاهده شده است. این یافته بر اهمیت پژوهشهای آتی در زمینه آموزش آگاهانه از ایمنی (safety-aware training) تأکید میکند.

AZR در عمل: آغاز با یک دانه کوچک

جالب است که فرآیند خودآموزی AZR تنها با یک «سهتایی بذر» (seed triplet) بسیار ساده آغاز میشود: یک تابع همانی (identity function) که هر ورودی را به همان شکل برمیگرداند. این نشان میدهد که مدل پایه LLM حتی بدون هیچ برنامه اولیه پیچیدهای قادر به راهاندازی چرخه یادگیری خودتکاملی است.

آیندهای روشن با «تجربه» به جای «داده»

پارادایم «صفر مطلق» و سیستم AZR گامی بلند به سوی هوش مصنوعی خودکفا و توانمند در یادگیری مستمر و بدون محدودیتهای دادههای انسانی است. این رویکرد نه تنها پتانسیل دستیابی به سطوح بالاتری از استدلال را فراهم میکند، بلکه میتواند درک ما را از فرآیند یادگیری در سیستمهای هوشمند متحول سازد. با انتشار کد، مدلها و لاگهای این پژوهش به صورت متنباز، جامعه علمی تشویق میشود تا بر پایه این یافتهها، مرزهای هوش مصنوعی را بیش از پیش جابجا کنند. شاید این سرآغاز «عصر تجربه» (era of experience) برای هوش مصنوعی باشد، جایی که یادگیری از تعامل مستقیم و خودساخته، جایگزین وابستگی به دادههای از پیش آماده شده انسانی میشود. این جهش کوانتومی، نویدبخش آیندهای است که در آن هوش مصنوعی نه تنها ابزاری قدرتمند، بلکه شریکی خلاق و خودآموز در مسیر پیشرفت بشر خواهد بود.

منبع

ZeroSearch: Incentivize the Search Capability of LLMs without Searching